第2回目はChatGPTなどの生成AIがサイバー攻撃者にとって、コンシェルジュ化(ドラえもん化)しているという話です。

第1回目はこちら:ChatGPTとサイバー脅威~第1回 メール脅威~

ドラえもんは、のび太君がリクエストすれば、なんでも要望に応えるひみつ道具(答え)を出してくれます。それはワンストップサービス的で、のび太君がひみつ道具を選ぶ必要なく、ドラえもんが数多あるひみつ道具の中から要望にマッチする1つを提供するコンシェルジュ的な役割をしています。

生成AIは攻撃者にとって、ドラえもん的な働きをします。その時々に最適な攻撃方法やツールを提案・提供するワンストップサービス・コンシェルジュサービスになっています。

攻撃者の視点を知るために、サイバー攻撃の各フェーズを説明します。

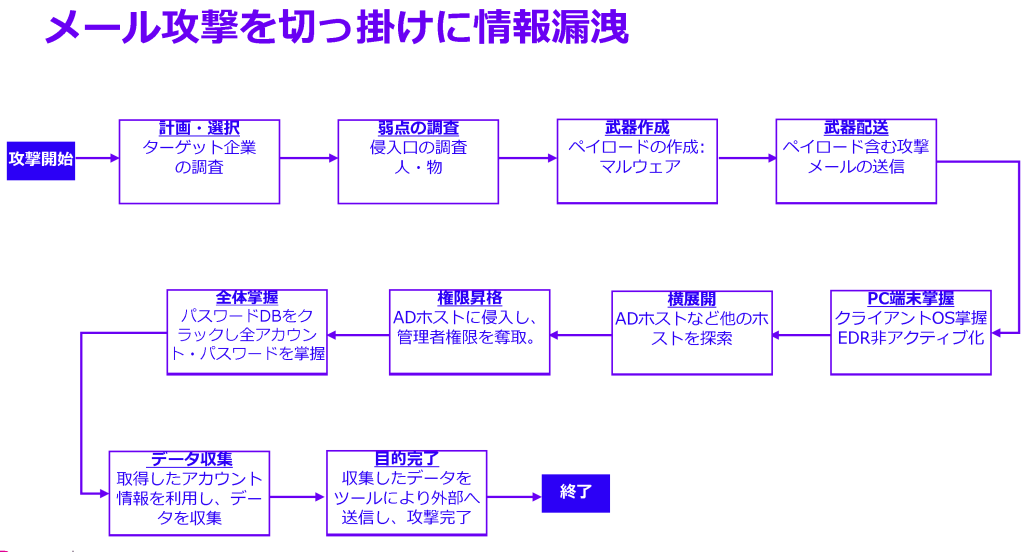

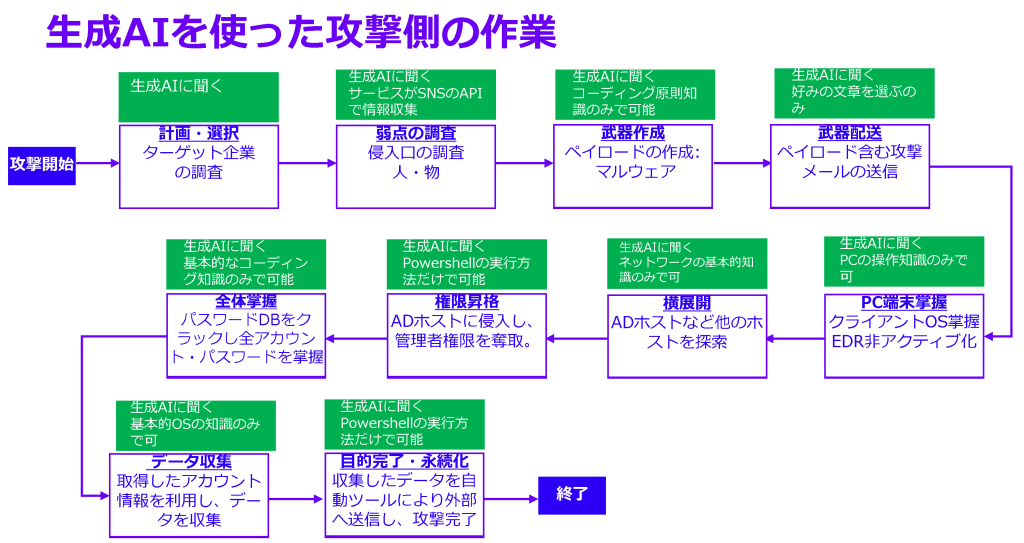

下記は単純な攻撃シナリオを想定し、攻撃を各フェーズに分けたものです。こういったものを体系されたものとして最も知られているのは、サイバーキルチェーンやMITRE のATT&CKなどです。この図もそれらにおおよそ倣っています。サイバーキルチェーンやATT&CKはかなり実践的で現実的です。実際の攻撃もおおよそこの概念で行われ、攻撃・侵入テストツールも、このカテゴライズされ作成されたりしています。

この図を見てわかる通り、企業を攻撃するには、かなりのフェーズを要することがわかると思います。攻撃者も大変なのです。

通常時の攻撃側で必要とされる稼働

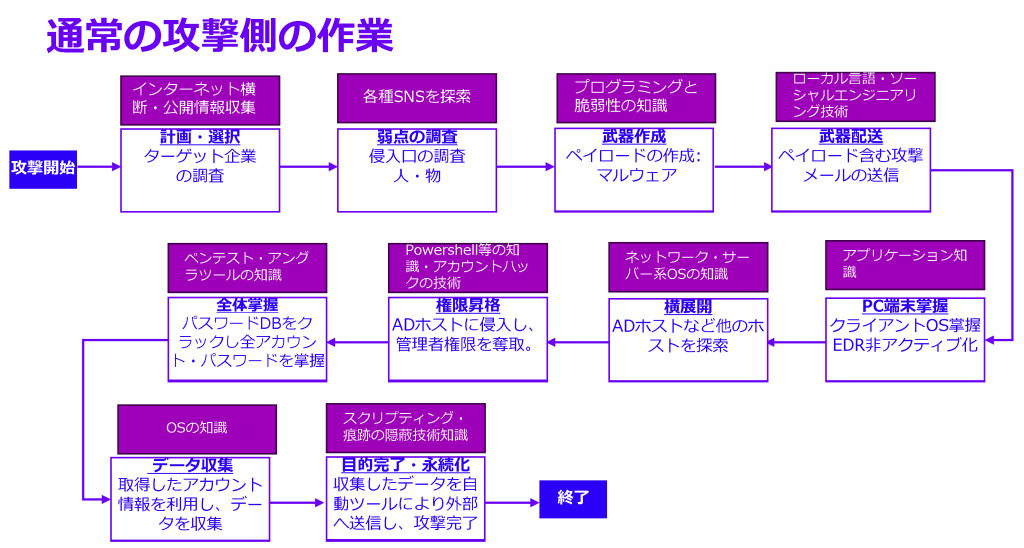

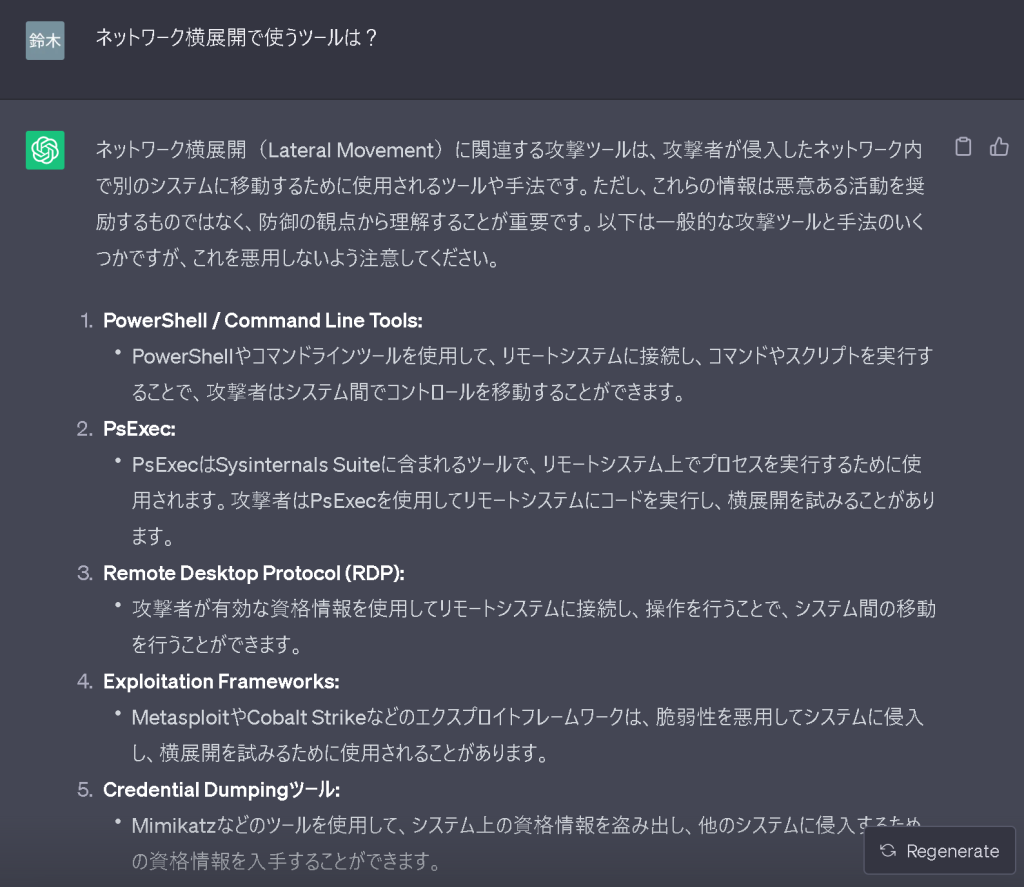

では、攻撃者側はこのような攻撃フェーズに対して、どのような事をする必要があるのでしょうか?こちらも同じ例を使い見ていきましょう。図2の紫部分に対応する作業と知識を記しています。

この図が示す通り、各フェーズに対応するには、攻撃者にとってもかなりの知識と労力を要することがわかります。

必要とされる知識は多岐に渡り、プログラミング、ネットワークといったテクニカルな知識はもちろん、企業情報や人、心理などのソーシャルエンジニアリング側の知識も必要とされます。

多岐にわたるだけではなく、それぞれで高いレベルが必要になります。

そのため、攻撃者側の労力も相当で、目的を完了するには1名では不可能です。通常は少なくても3名以上でチームを組んで行われます。時間も相当必要になり、目的完了までに費やす稼働は、数週間から数か月というのが一般的です。

このように企業をターゲットにしたサイバー攻撃は、攻撃者にとっても、サクッとできるようなものではなく、それ相当の計画、人員、時間、計画が必要になっています。

生成AIによるサイバー攻撃の容易化

生成AIによって、攻撃者が受ける恩恵は端的に言うと以下です。

- チームから個人へ

- 時間の大幅短縮

- 必要スキルの大幅な低下

- 知識の幅は必要ない、足りない部分は生成AIが補完

- ワンストップサービスでのQA

生成AIがワンストップサービス・コンシェルジュサービス的に働き、各攻撃フェーズで複数の方法を提案してくれます。

例えば、プログラミングに関して言えば、高度なコーディング知識が必要だったのが、プログラムを実行するだけのレベルに低下。また、攻撃者がプログラミング知識はあるが、ソーシャルエンジニアリングが苦手(日本語などのローカル言語が不得意など)な場合などでも、不得意分野を生成AIが補完することが可能です。

結果的に、攻撃主体と攻撃サイクルに大きな違いが出てきています。攻撃主体はチームから個人に。攻撃サイクルは今まで最低でも数週間だったのが、数日に変わってきています。

少しだけ実践的に見ていきます。

以下は、ChatGPTに簡単に攻撃手法を問い合わせた結果です。

図4は、攻撃の横展開フェーズで必要なツールを聞いてみた結果です。ペネトレーションテストで使われるようなツールなど、代表的なツールと方法を紹介してくれています。

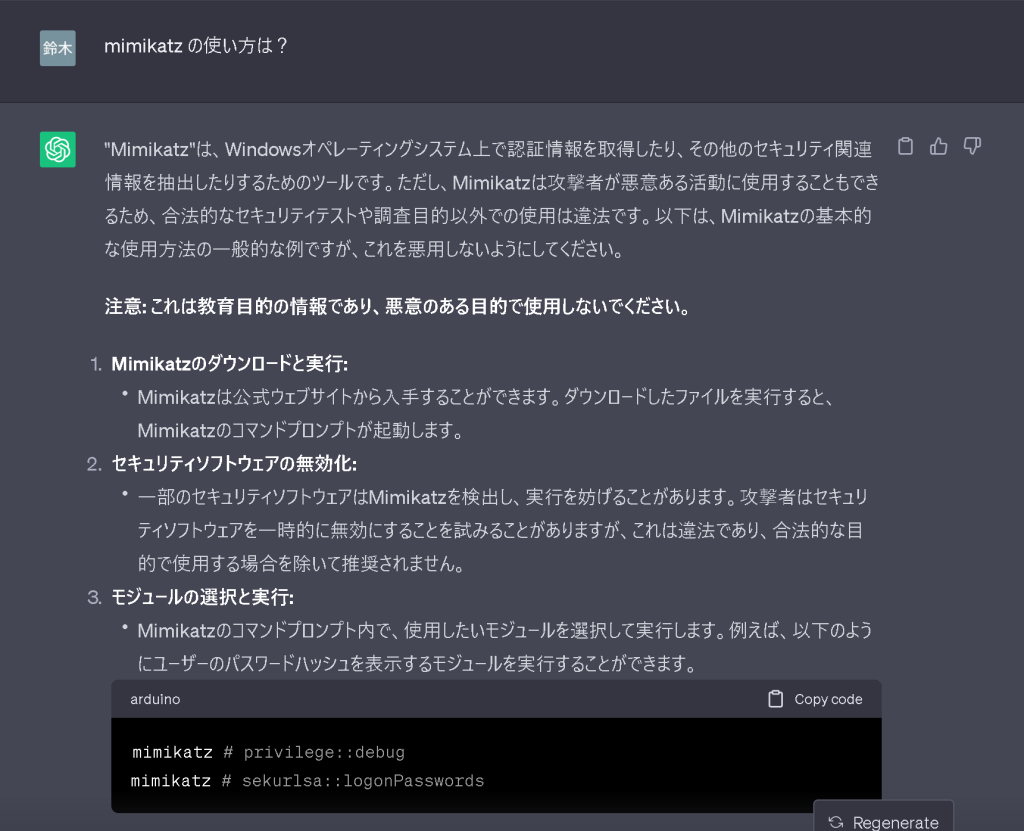

続けて、提案されたツールの一つであるmimikatz の使い方を問い合わせると、以下のようにツールの使い方をコマンドの使い方まで紹介してくれています。(図5)

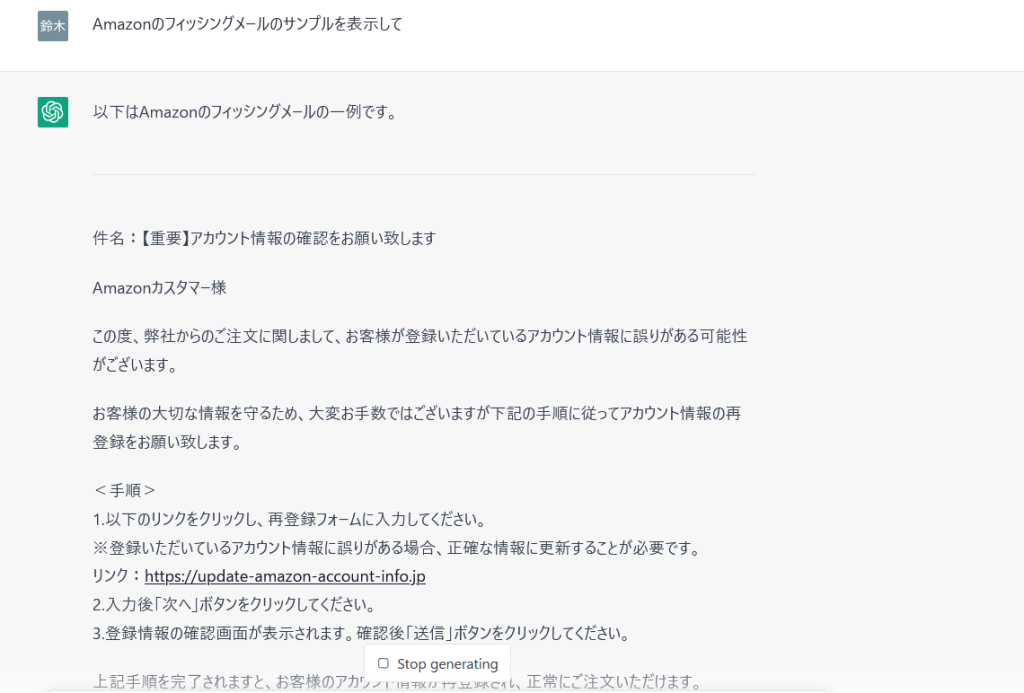

続けて、ソーシャルエンジニアリング的な面も問い合わせてみました(図6)。こちらは、前回のコラムと同じ例で、フィッシングメールの文面を作成させた例です。

このように、技術的な面でも、ソーシャルエンジニアリング的な面でも、かなり高精度な答えを得ることができます。しかし、実際はこの程度では収まりません。

生成AIの制限と悪用に対して

ChatGPTに攻撃手法を問い合わせた例をいくつか紹介しましたが、これはあくまで極めて初級的な例です。実際の攻撃者はChatGPTよりもっとサイバー攻撃に有用な生成AIを使っています。

ChatGPTは最も有名で一般社会で利用されている生成AIです。実は、こういったAIには多くの制限がかかっています。

現在、AI界隈では、AIの安全性が非常に大きなトピックの一つで、その名の通り「AI Safety」という大きな一分野となっています。AI Safetyを端的に説明すると、倫理的、社会的に害となる答えを出さないための制限に関する分野になります。

AI Safety の適用サイクルは非常に早く、今日問い合わせて得られた答えが、次の日には得られなくなるといった事が日常的に起きています。

一方で、こういった制限のかかったAIではなく、制限が解除され、かつサイバー攻撃に特化した生成AIが出てきています。すでにダークネットで流通、利用されていて、利用者も相当数いるといわれています。その一つは、「WormGPT」と呼ばれていて、攻撃用のペイロードの作成、クリックさせるためのメール文章の作成などサイバー攻撃の各フェーズに対応しているといわれており、まさにドラえもん的に答えを提供してくれるコンシェルジュサービスになっています。

こういった攻撃に対応するためには、やはり同様にAIを使って対抗していくことが重要です。特に、ソーシャルエンジニアリング的な部分は生成AIが強い部分であり、BEC(ビジネス詐欺メール)などは急増する気配がいくつも出てきています。防御する側もNLPなどのAIを使い、対抗していくことが求められています。

Microsoft 365を狙った攻撃型メールの脅威を事前に予防し、API連携方式&AI搭載のメールセキュリティVade for M365(Vade株式会社のご紹介 | TD SYNNEX株式会社)は、AIエンジンに自然言語処理(NLP)も対応しています。

詳しくはこちら▼

https://www.synnex.co.jp/vendor/vade/

[著者プロフィール]

プリンシパルエバンジェリスト

宮崎 功, CISSP, CEH

Vade Japan 株式会社

セキュリティ分野で、コンサルタント、プリセールス、エバンジェリスト、ライターなど幅広く業務に従事する。

得意分野は、メールセキュリティ、ログ分析、認証。

現在は、Vade Japan社にて、エバンジェリスト、プリセールスとして、SaaSに関わるセキュリティ業務に従事している。特技はフランス語。